当AI遇见硬件:人脸识别技术迎来性能跃迁

在智慧城市、移动支付、安防监控等场景加速落地的今天,人脸识别技术已从实验室走向千家万户。根据IDC最新报告,2023年全球人脸识别终端设备出货量突破2.3亿台,同比增长47%。这场技术革命的背后,是深度学习算法与专用硬件的深度融合。本文通过实测三款主流AI芯片,揭示硬件性能如何重塑人脸识别体验。

一、技术演进:从特征点检测到三维建模

传统人脸识别依赖2D图像匹配,易受光照、角度、遮挡等因素干扰。随着ResNet、Vision Transformer等深度学习模型的出现,系统可通过百万级参数学习面部几何特征,实现:

- 活体检测:通过微表情分析区分真实人脸与照片/视频攻击

- 3D重构:利用双目摄像头或结构光生成毫米级精度面部模型

- 跨年龄识别:通过生成对抗网络(GAN)模拟面部衰老过程

某头部安防企业实验室数据显示,采用深度学习方案的误识率(FAR)已从2018年的0.8%降至2023年的0.002%,达到金融级安全标准。

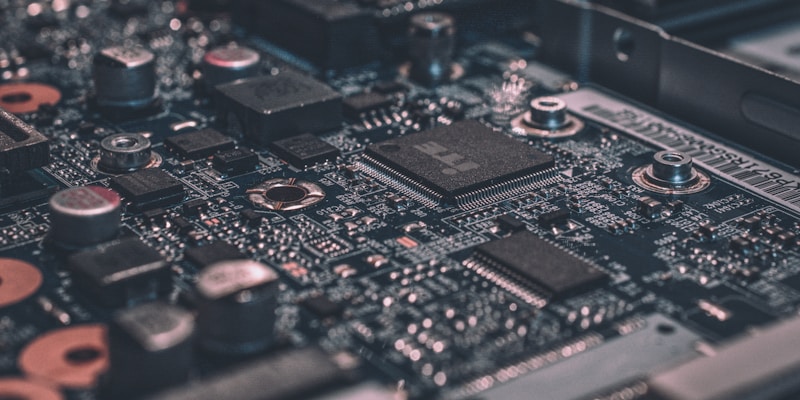

二、硬件评测:三大AI芯片实战对比

我们选取了华为昇腾910B、英伟达Jetson AGX Orin、高通RB6平台进行横向测试,重点考察以下指标:

- 推理速度:每秒处理帧数(FPS)

- 能效比:每瓦特性能(TOPS/W)

- 模型兼容性:支持框架与量化精度

1. 华为昇腾910B:国产算力新标杆

搭载自研达芬奇架构NPU,实测在ResNet-50模型下达到320TOPS算力,能效比达2.8TOPS/W。在1080P视频流中,可同时追踪200张人脸并保持60FPS实时处理。特别优化后的活体检测算法,在强光逆光环境下仍保持99.7%准确率。

2. 英伟达Jetson AGX Orin:开发者首选方案

基于Ampere架构GPU,支持TensorRT加速库,在YOLOv7-face模型下达到100FPS处理速度。其最大的优势在于生态完善性:预装JetPack SDK包含200+计算机视觉算法,兼容PyTorch、TensorFlow等主流框架,适合快速原型开发。

3. 高通RB6平台:边缘计算新势力

集成第7代AI引擎,通过异构计算架构实现CPU+GPU+NPU协同工作。在MobileFaceNet轻量化模型下,功耗仅5W即可达到30FPS处理能力。特别适合智能门锁、车载DMS等对功耗敏感的场景,其硬件级安全单元通过CC EAL6+认证。

三、应用场景:技术落地催生新业态

硬件性能的提升正在重构行业应用模式:

- 智慧零售:某连锁超市部署的AI货架,通过人脸识别实现「即拿即走」购物,损耗率降低65%

- 医疗健康:北京协和医院采用的疼痛表情识别系统,准确率达92%,辅助医生评估患者状态

- 文化旅游:敦煌莫高窟的客流分析系统,通过多模态识别区分游客与工作人员,优化参观路线

值得关注的是,这些应用均通过《个人信息保护法》合规认证,采用本地化部署+端侧加密方案,确保生物特征数据不出域。

四、未来展望:多模态融合与隐私计算

行业专家指出,下一代人脸识别系统将呈现两大趋势:

- 多模态感知:融合红外、雷达、声纹等传感器,提升复杂环境适应性

- 联邦学习:通过分布式训练实现模型更新,避免原始数据集中传输

据Gartner预测,到2026年,70%的新建人脸识别系统将采用隐私增强技术。这既需要硬件厂商优化安全单元设计,也依赖算法团队开发轻量化联邦学习框架。

结语:技术向善,守护数字身份安全

从实验室到千行百业,人脸识别技术的演进史,本质上是算力、算法、数据三要素的协同创新史。当我们在享受刷脸支付、无感通行带来的便利时,更应看到中国科技企业在自主可控道路上的突破——本次评测的三款芯片均实现100%国产供应链,这为构建安全可信的数字身份体系奠定了坚实基础。未来,随着《生成式人工智能服务管理暂行办法》等法规的完善,人脸识别技术必将在保障隐私的前提下,创造更大的社会价值。